La burbuja de la IA: ¿demasiado grande para caer?

Las señales de un inminente estallido de la burbuja económica en torno a la inteligencia artificial (IA) son evidentes para cualquiera que haya estado atento. Las valoraciones empresariales están desalineadas respecto a los ingresos reales; la financiación de iniciativas vinculadas a la IA ha pasado de modelos basados en capital a modelos basados en crédito –considerados más arriesgados por muchos analistas–; y las empresas recurren cada vez más a complejos acuerdos cruzados para sostenerse mutuamente. Si el sector evita el estallido, probablemente será porque Estados Unidos y otros gobiernos intervengan de forma preventiva para respaldar lo que consideren un sector demasiado grande y valioso para dejarlo caer.

Pero ¿es realmente la IA demasiado valiosa para fracasar? Cualesquiera que sean las medidas –preventivas o posteriores al estallido– que se contemplen, los gobiernos deben incorporar algo más que el valor económico a sus cálculos. Decidir qué aplicaciones, infraestructuras y activos merecen protección pública, y cuáles deberían dejarse a la deriva, exige evaluar sus implicaciones sociales, culturales y democráticas, además de su contribución potencial a la productividad y al crecimiento. Desde una concepción más amplia del valor, puede que partes de la economía de la IA sean demasiado grandes como para permitirse que triunfen.

Burbujas buenas y burbujas malas

El experto en innovación William H. Janeway sostiene que lo que debamos hacer ante una burbuja especulativa depende de su objeto: “¿Tienen los activos que atraen la especulación el potencial de aumentar la productividad económica cuando se despliegan a gran escala?”. Si la respuesta es afirmativa, podría justificarse el rescate de determinadas tecnologías, activos o empresas.

Para Janeway, la burbuja crediticia de 2004–2007 –que desembocó en la crisis financiera global de 2008–2009– se centró en mecanismos financieros altamente complejos que no generaban valor real. En cambio, la burbuja tecnológica de los años noventa –que culminó en el estallido puntocom de 2000–2001– giraba en torno a internet y a su infraestructura física subyacente, que posteriormente sí produjo ganancias sustanciales de productividad y crecimiento. La pregunta difícil hoy es: ¿dónde se sitúa la burbuja de la IA dentro de ese espectro?

Sin embargo, aunque el criterio de Janeway resulta útil, su énfasis en la productividad es demasiado estrecho para las decisiones actuales. No basta con valorar los beneficios y riesgos económicos de la IA; es necesario considerar también sus dimensiones sociales, culturales, políticas y medioambientales. Con este conjunto ampliado de criterios, distinguir entre una “buena” y una “mala” IA se vuelve aún más complejo.

Puede existir un valor social y económico genuino en sistemas de IA que, por ejemplo, asistan –sin sustituir– a médicos en diagnósticos clínicos, mejoren el control de calidad en la industria o ayuden a preservar lenguas indígenas en riesgo de desaparición. En términos de productividad, algunos estudios recientes indican que pocas empresas que adoptan IA están registrando mejoras, mientras que otros muestran señales positivas – una incertidumbre coherente con la experiencia de tecnologías anteriores, que atravesaron fases iniciales de rendimientos modestos antes de generar beneficios sustanciales. Incluso si las ganancias de productividad no se materializan antes del estallido, podría haber razones para rescatar infraestructuras subyacentes o activos varados si consideramos que la IA puede generar otras formas de valor.

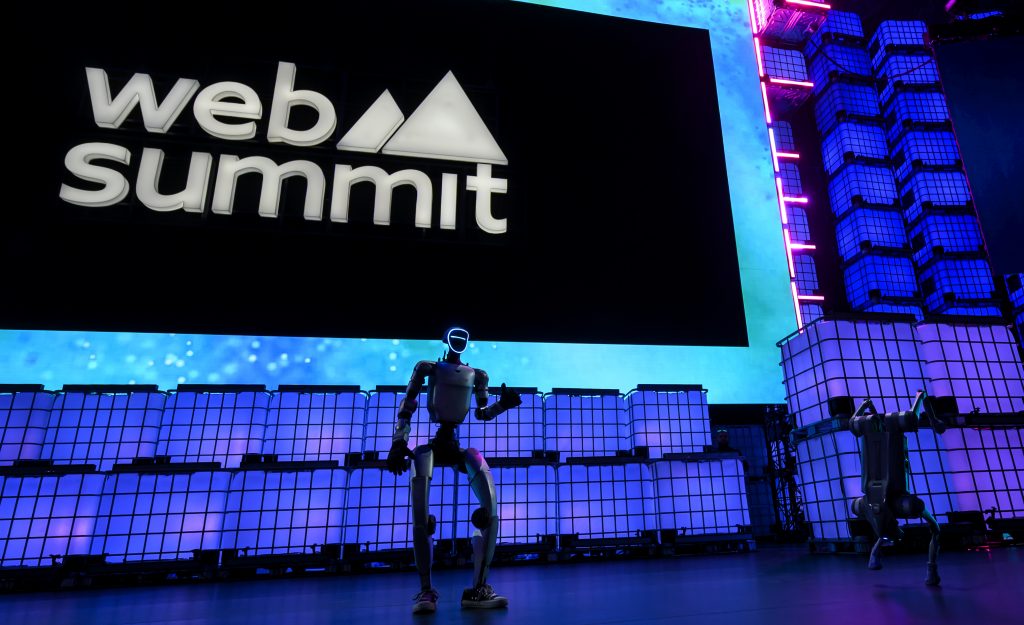

Al mismo tiempo, estamos inundados de “IA basura”: imágenes, vídeos, textos y audios de escaso valor y baja calidad producidos con mínimo esfuerzo mediante sistemas generativos. Aunque vídeos simpáticos de osos panda desfilando por pasarelas puedan resultar inofensivos, las mismas herramientas se utilizan para producir contenidos que generan graves daños sociales y políticos. La IA se ha empleado para crear vídeos deepfake destinados a interferir en procesos electorales, acosar a mujeres y niñas y erosionar la confianza en la existencia de una realidad compartida. Investigadores, filósofos y activistas llevan casi una década documentando y analizando estos daños, pero es poco probable que sus advertencias ocupen un lugar central en los debates sobre posibles rescates financieros del sector.

En última instancia, lo que hagamos ante la burbuja de la IA dependerá de cómo valoremos lo que distintos tipos de IA crean o destruyen. Aquellas aplicaciones e infraestructuras que aporten –o tengan un potencial real de aportar– valor social, cultural o económico podrían justificar apoyo público. Al mismo tiempo, dado que algunas aplicaciones pueden tanto crear como destruir valor, las que se rescaten deberían someterse a una regulación más estricta. La cuestión clave es que, al pensar cómo guiar la economía de la IA en su fase posterior a la burbuja, las comunidades democráticas deben ejercer un juicio colectivo exigente, establecer distinciones y utilizar su poder soberano para configurar el futuro tecnológico que desean.

¿Demasiado grandes para tener éxito?

Además de decidir qué hacer con aplicaciones y contenidos específicos, la burbuja de la IA plantea un desafío más amplio: si determinadas empresas tecnológicas deberían ser sostenidas o no. Las burbujas especulativas del pasado obligaron a los gobiernos a preguntarse si algunas compañías eran “demasiado grandes para quebrar” por su importancia sistémica. La burbuja de la IA introduce una pregunta distinta: ¿hay empresas demasiado grandes para que se les permita triunfar, dada la magnitud de su influencia sobre la sociedad y la política democrática?

Algunas compañías aspiran sinceramente a desarrollar sistemas que generen valor social y económico. Otras, en cambio, facilitan de forma consciente comportamientos maliciosos por parte de actores estatales y no estatales, incluyendo prácticas de vigilancia, secuestros y otras violaciones de derechos humanos. Las democracias que evalúen cómo actuar ante la burbuja deberían considerar no solo la contribución económica de estas empresas, sino también si sus productos y servicios fortalecen o erosionan los derechos humanos y la sociedad civil.

Además, el mero hecho de que ciertas empresas tecnológicas –con independencia de sus intenciones– concentren un enorme poder económico, cultural y político, con capacidad para distorsionar el debate público, influir en la toma de decisiones y debilitar la gobernanza democrática, constituye ya un problema. Una alianza entre defensores de la competencia y partidarios de la democracia podría ver en la burbuja de la IA una oportunidad para replantear qué empresas son demasiado grandes para triunfar y para impulsar regulaciones que limiten el poder económico y político de las que sobrevivan.

Elegir ver

En su novela Ensayo sobre la ceguera, José Saramago imagina una comunidad afectada por una epidemia de “ceguera”. Mientras sus habitantes enfrentan la degradación moral que aflora con la crisis, algunos empiezan a sospechar que su ceguera literal es la manifestación de una ceguera moral previa. Uno de los personajes afirma: “Creo que no nos quedamos ciegos, creo que estamos ciegos. Ciegos que ven. Ciegos que, viendo, no ven”.

Para muchos, el avance acelerado de la IA ha ido acompañado de una ceguera moral selectiva. El énfasis casi exclusivo en los posibles beneficios económicos ha llevado a ignorar las voces de quienes han sufrido o presenciado sus daños reales. Si –y cuando– la burbuja estalle, el impacto financiero ocupará el centro del debate. Pero nuestras sociedades estarán en mejor posición si, al deliberar sobre rescates públicos, incorporamos también valores sociales, culturales y democráticos.

Artículo traducido del inglés, publicado originalmente en el Centre for International Governance Innovation (CIGI).